Google Gemma 4 출시: 온디바이스 에이전트 최적화와 MoE 기반 고성능 AI 코딩 도구

Google DeepMind가 에지 디바이스에서 자율 에이전트 구현이 가능한 Gemma 4를 공개했습니다. Apache 2.0 라이선스와 MoE 아키텍처를 통해 저비용·고성능 로컬 AI 환경 및 바이브코딩 워크플로를 지원합니다.

원문 보기Google AI Blog→

📌 원문: Google Gemma 4 출시: 온디바이스 에이전트 최적화와 MoE 기반 고성능 AI 코딩 도구 — Google AI Blog

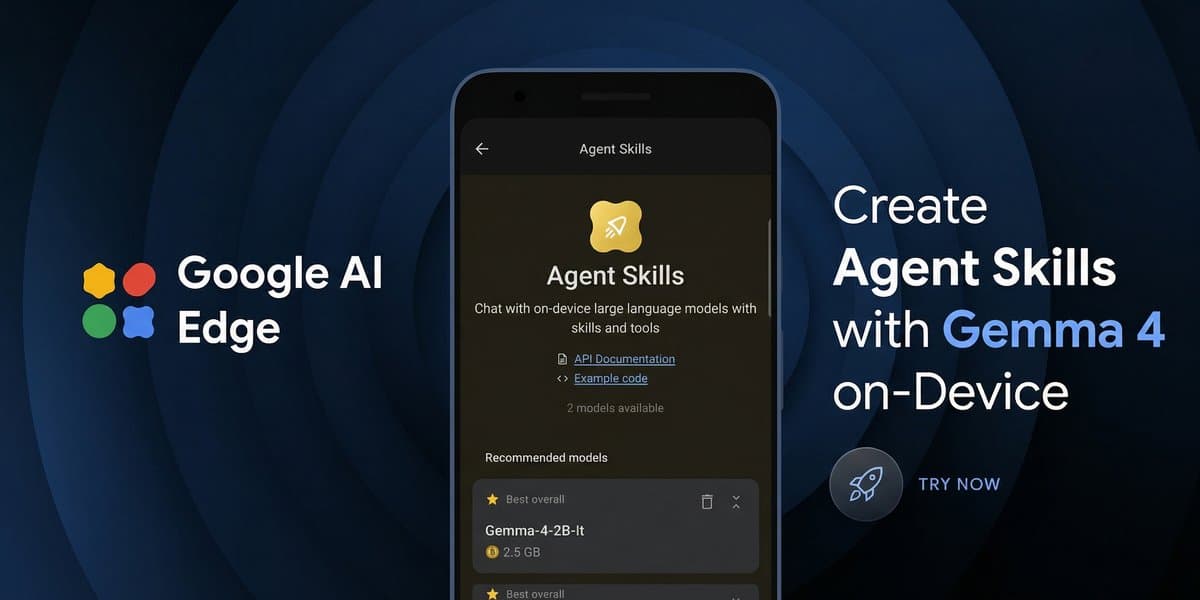

Google DeepMind가 에지(Edge) 디바이스 환경에서 자율적인 에이전트 워크플로를 구현할 수 있도록 설계된 차세대 개방형 모델인 Gemma 4를 출시했다. 이번 업데이트는 클라우드 의존도를 낮추고 로컬 환경에서의 인공지능 민주화를 목표로 하며, 멀티스텝 계획(Multi-step Planning)과 향상된 추론 능력을 핵심으로 내세우고 있다.

무엇이 바뀌었나

- 에이전트 중심 설계(Agentic-centric Design): 온디바이스 환경에서 멀티스텝 계획 및 자율적인 에이전트 워크플로를 수행할 수 있는 성능 확보.

- 모델 라인업 다양화: 효율성을 극대화한 E2B(2.3B), E4B(4.5B) 모델부터 MoE(Mixture of Experts) 아키텍처 기반의 26B-A4B, 그리고 성능 중심의 31B 모델까지 총 4종을 제공.

- LiteRT-LM 라이브러리 도입: 에지 디바이스에서의 실행 속도를 대폭 개선하고, 개발자가 결과값을 제어하기 용이한 구조화된 출력(Structured Output) 기능 지원.

- 컨텍스트 윈도우 확장: 128K에서 최대 256K의 컨텍스트를 지원하여 대규모 코드베이스나 긴 문서를 로컬에서 효율적으로 처리 가능.

- 개방형 라이선스: Apache 2.0 라이선스를 적용하여 상용 서비스 및 연구 목적의 자유로운 활용 보장.

상세 분석

Gemma 4의 가장 큰 기술적 특징은 에지 환경 최적화와 에이전트 능력의 결합이다. 특히 31B 모델의 경우 벤치마크 테스트에서 상용 모델인 GPT-5.2 및 Gemini 3 Pro를 상위하는 성능을 보여주었으며, 운영 비용 측면에서도 기존 클라우드 API 대비 약 20배 저렴한 수치를 기록했다.

MoE(Mixture of Experts) 기반 효율성 26B-A4B 모델은 MoE 구조를 채택하여, 전체 파라미터를 모두 활성화하지 않고도 높은 추론 성능을 유지한다. 이는 메모리 자원이 제한적인 에지 디바이스에서 고성능 AI를 구동할 수 있는 핵심 기제로 작동한다.

함수 호출(Function Calling) 및 시스템 프롬프트 강화 Gemma 4는 네이티브 함수 호출 기능을 지원하여 외부 API나 로컬 도구와의 연동이 매끄럽다. 이를 통해 개발자는 특정 도구를 실행하거나 정해진 형식으로 데이터를 반환하는 에이전트를 보다 쉽게 구축할 수 있다.

# Gemma 4를 활용한 구조화된 출력 예시 (LiteRT-LM 기반 개념 코드)

from gemma_edge import Gemma4Agent

agent = Gemma4Agent(model="gemma-4-4b-it")

# 시스템 프롬프트를 통한 에이전트 역할 정의

agent.set_system_prompt("당신은 로컬 파일 시스템을 관리하는 에이전트입니다.")

# 도구 사용 및 멀티스텝 계획 수행

response = agent.run_step(

task="현재 디렉토리의 모든 .py 파일을 분석하고 구조를 JSON으로 반환해줘.",

tools=["list_files", "read_file"]

)

# 구조화된 출력(Structured Output) 확인

print(response.structured_json)

실무 적용 포인트

Gemma 4는 데이터 보안이 중요한 기업 내부 도구 개발이나 지연 시간(Latency)이 민감한 실시간 서비스에 강력한 대안을 제시한다.

- 로컬 에이전트 기반 바이브코딩(Vibe Coding): 1인 개발자나 소규모 팀은 Raspberry Pi 5나 NVIDIA Jetson과 같은 저전력 하드웨어에서도 Gemma 4를 구동하여, 인터넷 연결 없이도 동작하는 자율형 코딩 에시스턴트를 구축할 수 있다. 특히 4비트 양자화(Q4_0) 적용 시 3.2GB~17.4GB 수준의 VRAM만으로도 배포가 가능하다.

- 비용 최적화 및 파인튜닝: Unsloth나 NVIDIA의 최적화 도구를 활용하면 로컬 워크스테이션에서 적은 자원으로도 도메인 특화 파인튜닝(Fine-tuning)이 가능하다. 이는 클라우드 GPU 비용을 절감하면서도 특정 비즈니스 로직에 최적화된 모델을 확보하는 전략이 된다.

실무 활용 팁:

- 하드웨어 가속 활용: 모바일 디바이스나 IoT 플랫폼 배포 시 반드시 LiteRT-LM을 사용하여 GPU 및 NPU 가속을 활성화해야 실시간 에이전트 성능을 확보할 수 있다.

- 멀티모달 워크플로 구성: Gemma 4는 텍스트 외에도 이미지와 비디오를 지원하므로, 로컬 보안 카메라 분석이나 시각적 자산 관리 에이전트 등으로 확장하여 사용할 수 있다.

📎 참고 링크

댓글

아직 댓글이 없습니다. 첫 번째 댓글을 남겨보세요!