FunctionGemma 출시: 온디바이스 함수 호출로 가속화되는 모바일 AI 에이전트 개발

구글이 270M 파라미터의 경량 모델 FunctionGemma를 통해 모바일 기기 내 오프라인 함수 호출 기능을 지원합니다. 저지연성과 프라이버시가 강화된 AI 에이전트 서비스 빌드가 가능해집니다.

원문 보기Google AI Blog→

📌 원문: FunctionGemma 출시: 온디바이스 함수 호출로 가속화되는 모바일 AI 에이전트 개발 — Google AI Blog

무엇이 바뀌었나

- 경량 모델 FunctionGemma 출시: 2억 7천만(270M) 파라미터 규모의 온디바이스(On-device) 전용 모델이 공개되었다.

- 온디바이스 함수 호출(Function Calling) 지원: 클라우드 연결 없이 기기 내부에서 사용자 의도를 파악하고 특정 함수를 실행할 수 있다.

- LiteRT-LM 기반 최적화: 구글의 AI Edge 및 LiteRT-LM(구 TensorFlow Lite) 기술을 활용해 모바일 환경에서의 추론 속도와 효율성을 극대화했다.

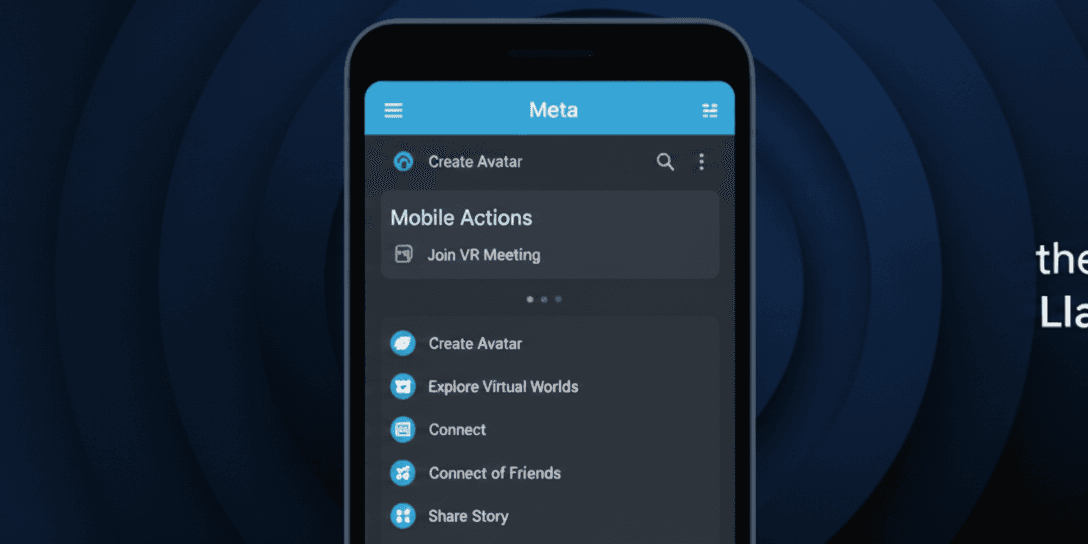

- 크로스 플랫폼 지원: 안드로이드(Android)와 iOS를 모두 지원하며, Google AI Edge Gallery 앱을 통해 즉시 테스트가 가능하다.

- 오프라인 에이전트 환경 구축: 인터넷 연결 없이도 일정 관리, 하드웨어 제어, 게임 로직 실행 등 복잡한 태스크를 수행한다.

상세 분석

FunctionGemma는 단순한 텍스트 생성을 넘어, 사용자의 입력을 구조화된 데이터로 변환하여 실제 시스템의 함수를 호출하는 '에이전트(Agentic)' 기능에 특화되어 있다. 270M라는 극소형 파라미터 사이즈에도 불구하고 정확한 파라미터 추출이 가능하도록 설계되어, 모바일 기기의 제한된 리소스에서도 저지연(Low Latency) 성능을 보장한다.

모델은 사용자의 자연어 입력을 분석하여 정의된 함수 목록 중 적절한 것을 선택하고, 실행에 필요한 인자(Arguments)를 JSON 형태로 출력한다.

[함수 호출 구조 예시] 사용자가 "거실 전등을 켜줘"라고 명령할 경우, 모델은 내부적으로 다음과 같은 구조화된 데이터를 생성하여 로컬 시스템에 전달한다.

// 모델 출력 예시 (추론 결과)

{

"call": "update_device_status",

"arguments": {

"location": "living_room",

"device": "light",

"status": "on"

}

}

이 과정이 기기 내부에서 완결되므로 데이터가 외부 서버로 전송되지 않아 프라이버시 보호에 유리하며, 네트워크 상태와 무관하게 즉각적인 반응 속도를 제공한다. 이는 Apple의 온디바이스 ML이나 Meta의 Llama Edge와 비교했을 때, 모델의 경량화 측면에서 높은 효율성을 보여주는 것으로 분석된다.

실무 적용 포인트

개발자는 클라우드 API 호출 비용을 절감하면서도 강력한 AI 기능을 모바일 앱에 통합할 수 있다. 특히 실시간 응답이 필수적인 게임 로직 제어나 외부 유출이 민감한 개인 정보(캘린더, 건강 데이터 등) 기반 서비스에 최적화되어 있다.

구체적 활용 팁

- 하이브리드 아키텍처 설계: 복잡한 추론은 클라우드 모델(Gemini 등)에 맡기고, 하드웨어 제어나 즉각적인 UI 피드백이 필요한 액션은 FunctionGemma를 통해 온디바이스로 처리함으로써 사용자 경험(UX)을 개선할 수 있다.

- 에이전트형 IoT 앱 개발: 인터넷 연결이 불안정한 환경에서도 동작해야 하는 스마트 홈 제어 앱이나 산업용 현장 단말기에 적용하여, 오프라인 상태에서도 음성/텍스트 기반의 장비 제어 기능을 구현할 수 있다.

댓글

아직 댓글이 없습니다. 첫 번째 댓글을 남겨보세요!